Synthèse de l’étude

Mise à jour du 31 mai 2021

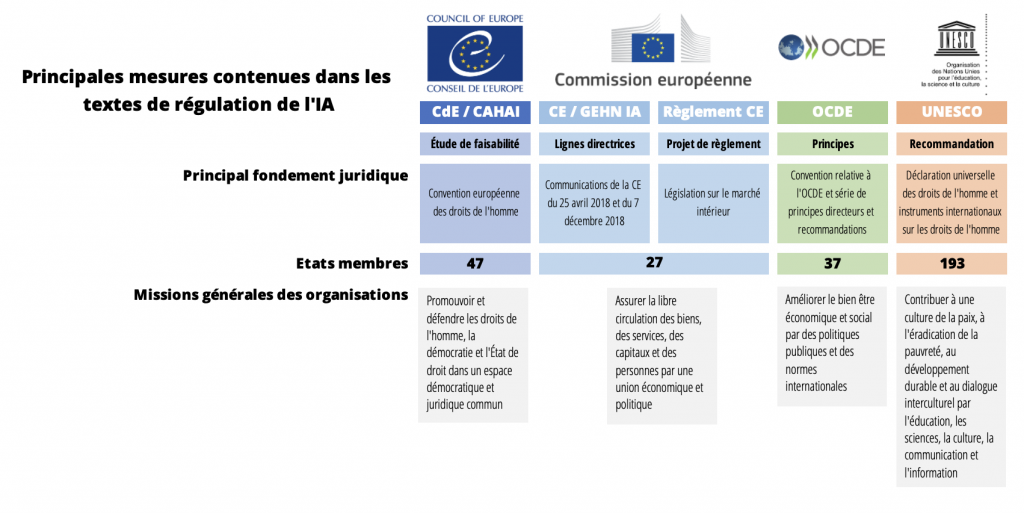

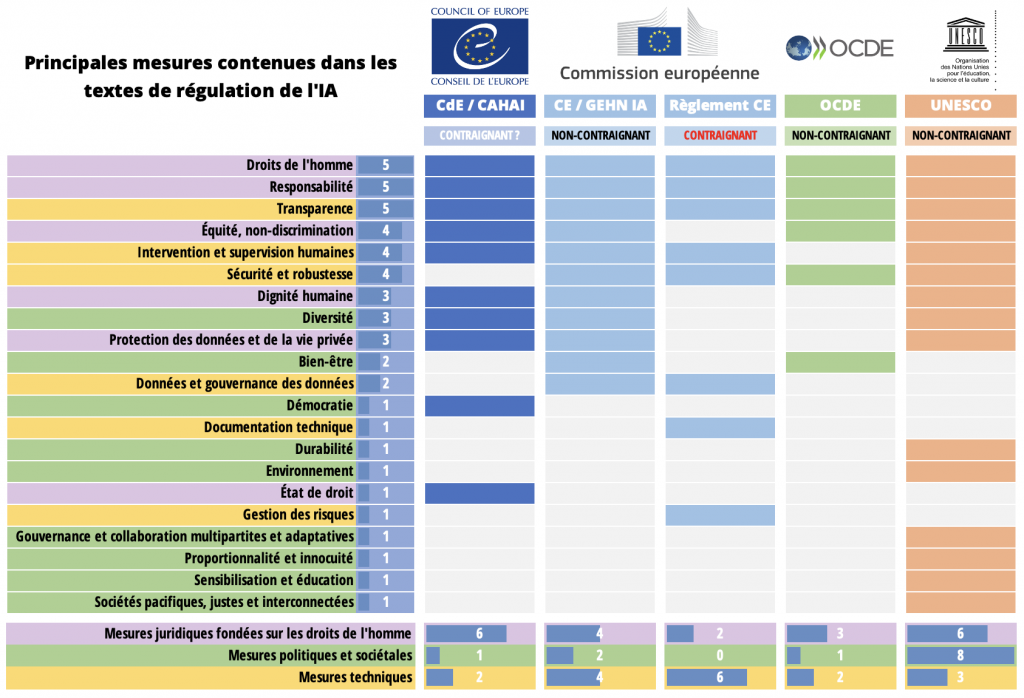

L’intervention des régulateurs internationaux pour encadrer le développement et l’application de l’intelligence artificielle vient en réponse à une inquiétude croissante dans l’opinion publique, confortée par la recherche, quant aux effets directs et indirects de cette technologie sur les droits des individus et la société. Les propositions de cadres éthiques n’ayant pas semblé apporter une réponse satisfaisante et convaincante, des organisations intergouvernementales telles que le Conseil de l’Europe, l’Union européenne, l’OCDE et l’UNESCO ont produit, sous l’impulsion de leurs États membres, de nombreux rapports, études, lignes directrices ou recommandations. Si ce qui pourrait être considéré comme du « droit souple » (soft law) présente une influence politique, technique et morale bien plus substantielle que de simples déclarations de bonne volonté des acteurs de l’IA, l’année 2021 marque toutefois un nouveau tournant, avec le premier texte juridiquement contraignant proposé par la Commission européenne en avril 2021 pour renforcer la sécurité des produits d’IA. Le Conseil de l’Europe envisage également un mélange d’instruments juridiques contraignants et non contraignants pour prévenir les violations des droits de l’homme et des atteintes à la démocratie et à l’État de droit.

Dans ce contexte de forte activité intergouvernementale, de nombreux observateurs, dont certains des États membres de ces organisations, se sont soucié de la cohérence de ces initiatives. Cette étude tend à démontrer que, même en l’absence de coordination formelle, la cohérence des initiatives les plus significatives sélectionnées (Conseil de l’Europe, Commission européenne – Union européenne, OCDE, UNESCO) apparaît tout d’abord résulter du mandat de chacune des organisations internationales. Des convergences apparaissent également sur le fond, s’agissant par exemple de la définition juridique des systèmes d’intelligence artificielle ou encore d’une approche fondée sur les risques, afin de ne pas imposer de trop fortes contraintes réglementaires à des dispositifs algorithmiques sans enjeux importants. La conformité (compliance) paraît ainsi se substituer progressivement à l’éthique, en annonçant trouver ses fondements dans les droits de l’homme et non dans des principes de philosophie morale ou un transfert de la bioéthique. De manière générale, les mécanismes juridiques semblent chercher à concilier innovation, sécurité et droits des personnes, dans l’intérêt de créer de la confiance pour le développement du marché des systèmes d’IA.

Des points de recouvrement ou de possibles divergences demeurent cependant. Si la réalisation d’études préalables de conformité fait consensus, leurs modalités ne font pas encore l’objet d’une normalisation. Les projets de textes ou les textes étudiés font aussi parfois apparaître des positions de compromis entre les États membres, notamment en Europe, avec des positions n’étant pas encore totalement stabilisées. Il doit être également relevé que des sujets controversés, comme l’emploi de la reconnaissance faciale dans l’espace public à des fins de sécurité publique[1], ne font pas l’objet d’un consensus avec la société civile, même si les préoccupations sécuritaires résultant de la menace terroriste et de la crise sanitaire laisse supposer une généralisation de ces dispositifs à plus ou moins court terme, encadrée par l’autorité judiciaire.

Enfin, les textes étudiés n’envisagent pas à ce stade de modalités procédurales spécifiques (pensons notamment à l’administration de la preuve ou des recours collectifs) contre des décisions prises/assistées par des algorithmes dans certains cas sensibles d’application et laissent encore apparaître la nécessité d’approfondir le débat démocratique au regard de la portée des enjeux de la transition numérique, notamment par des mécanismes inclusifs et participatifs allant plus loin que des consultations multipartites.

Accès au projet complet d’étude (fichier PDF sous licence Creative Commons (CC) BY-NC-ND, v.0.4 mise à jour du 31 mai 2021)

[1] Le terme d’identification biométrique à distance « en temps réel » a été préféré au terme de reconnaissance faciale dans la proposition de règlement sur l’IA de la Commission européenne.

Magistrat et maître de conférences associé à l’université de Strasbourg

Auteur des ouvrages « L’intelligence artificielle en procès » (Bruylant) et « IA générative et professionnels du droit » (LexisNexis)

Les opinions exprimées n’engagent que son auteur.

Liens utiles

- Étude de faisabilité du Comité ad hoc sur l’intelligence artificielle (Conseil de l’Europe)

- Lignes directrices éthiques pour une IA digne de confiance (Groupe d’experts indépendants de haut niveau, Commission européenne)

- Proposition de règlement de l’intelligence artificielle (Commission européenne)

- Recommandation du Conseil sur l’intelligence artificielle (OCDE)

- Projet de Recommandation sur l’éthique de l’intelligence artificielle (UNESCO)